#74 ディープラーニングとは

>100 Views

May 13, 26

スライド概要

『5th STEP ディープラーニング』、はじまります!

最初のSectionは、『#74 ディープラーニングとは』

本スライドは、データサイエンスの次のステップとしてディープラーニングを位置付け、ニューラルネットワークの原理やヒューブ則に基づく記憶モデル、パーセプトロンから多層構造への発展、バックプロパゲーションによる学習手法を紹介します。また、従来の機械学習との違いとして特徴量設計の自動化や非構造化データへの高い性能を説明し、Googleの実例や日本人研究者の貢献を交えて具体例を示します。さらに、データに意味付けを行うアノテーションの役割と医療画像・NLP・自動運転などの活用例も取り上げ、ディープラーニングを実践的に理解できるようにまとめています。

すべてのビジネスパーソンが意思決定プロセスにデータを活用する思考を身につけるため、まずは、データサイエンスの分析を体験していきましょう。SECIモデルの最初の段階、共同化(Socialization)からはじめていきます。 下記のブログで、ここにアップしたスライド、動画を随時、公開中です。 【ブログ】https://tutorial4datascience.blogspot.com/ 【Youtubeチャンネル】https://www.youtube.com/@DataScience_for_everyone 【Kindle】そして、このブログをまとめて書籍にしました! https://amzn.to/4ryVppn https://amzn.to/4pGgFb1

関連スライド

データサイエンス関連資格

データサイエンス関連の資格_後編

各ページのテキスト

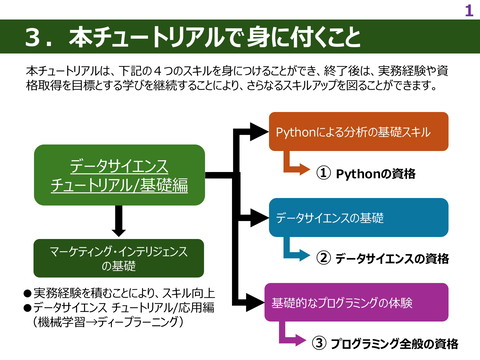

データサイエンス チュートリアル 5th STEP ディープラーニング deep learning

データサイエンス チュートリアル 次のステップは、ディープラーニングです。 1st STEP ビッグデータの読み 込みとデータの確認 2nd STEP 集計とグラフ描画 3rd STEP 応用編 医療 4th STEP 機械学習 データサイエンス チュートリアル 2

5th STEP ディープラーニング Section 1 ディープラーニングとは? データサイエンス チュートリアル 3

ディープラーニングのポジション 人間の脳の神経回路を模した「ニューラルネットワーク」を多層(ディープ)に重ね、AI が大量のデータから特徴やパターンを自動で学習する機械学習手法 AI 機械学習 ルールベース (エキスパートシステム) 遺伝的アルゴリズム 教師あり学習 教師なし学習 強化学習 ディープラーニング データサイエンス チュートリアル (deep learning) 4

ディープラーニングの原理 データサイエンス チュートリアル 5

記憶とは? ドナルド・ヘッブ(1949年) ヘブ則/ニューロン1の発火がニューロン2を発火させると2つのニューロンの結合が強まる。これ が脳の中で起こっている記憶の基礎現象であり、ニューロン同士の結合が強まるということは記憶したということ。 出典 https://www.wakodo.co.jp/product/special/babyfood/babyfood/global/advice/article01.html データサイエンス チュートリアル 6

コンピュータ上における神経細胞のモデル化 形式ニューロン パーセプトロン 1943年 ウォーレン・マカロック、 ウォルター・ピッツ 1958年 フランク・ローゼンブラット ●人間のニューロン(神経)の 活動を模倣したモデル ●形式ニューロンを組み合わせた モデル データサイエンス チュートリアル ニューラルネットワーク ●多層パーセプトロンと比べて 学習機能あり 7

ディープラーニング ●多数の層からなるニューラルネットワークの学習のことを、ディープラーニング(深層学習)とよび、ジェフェリー・ヒントン (後にGoogle所属)が概念を提唱、開発。 ●ヒトの知能に部分的に迫る(あるいは凌駕する)高い性能をしばしば発揮。 データサイエンス チュートリアル 8

バックプロパゲーション/ディープラーニングの学習方法 ニューラルネットワークでは、入力に対して重み付けやバイアスをかけ出力をしますが、その結果に対して、ニューロンの重み付け やバイアスを調整していくのが、バックプロパゲーション(Backpropagation/誤差逆伝播法)。予測の誤差を、出力側か ら入力側へと「逆方向」に伝えていき、各層のパラメーター(重み)をどれくらい修正すべきかを計算する機能です。 データサイエンス チュートリアル 9

【参考】 ディープラーニングを支えた日本人 福島 邦彦 甘利 俊一 1967年 確率的勾配降下法 1980年 ネオコグニトロン ジェフェリー・ヒントン デビッド・ラメルハートら ジェフェリー・ヒントン 2012年 CNN 1986年 バックプロパゲーション 画像認識のデファクト ディープラーニングの 主な学習手法 データサイエンス チュートリアル 10

ディープラーニングの特徴 データサイエンス チュートリアル 11

特徴量(1) では、従来の機械学習とディープラーニングは、どのような違いがあるのでしょうか? それを解説する前に、特徴量という概念を理解しておきましょう。そもそも、機械学習とは、大量な学習データをもとに法則やパ ターンを見出すことです。『法則やパターン』を大量のデータから見つけ出す際に、データのどのような特徴に着目すべきかを表す 変数が『特徴量』です。 一言で表すと、分析対象データの中の、予測の手掛かりとなる変数のことです。 #57に出てきた『insurance』というデータを思い出 してください。 ■説明変数:何かの原因となっている変数 ■目的変数:その原因を受けて発生した結果と なっている変数 このようなデータでは、説明変数の1つの「列」が1つ の特徴量と言い換えることができます。 データサイエンス チュートリアル 12

特徴量(2) ビッグデータが蓄積されはじめると、行・列を持ち表形式に整形されている構造化データばかりではなく、画像・映像・音声・テ キストなどの『非構造化データ』が集積されるようになってきました。 例えば、デジタル画像を構成する最小の単位はピクセル(Pixel/画素)ですが、これらは人の判断で特徴量を選択するこ とが困難です。 構造化データ 非構造化データ 行・列を持ち、表形式に整形されている構造化データ 列単位で特徴量を選択 画像・映像・音声・テキストなどの非構造化データ 人の判断で特徴量選択が困難 データサイエンス チュートリアル 個々のピクセルの色は、単色 13

Googleの猫 そこで、開発された手法が、特徴量をAI自身が導き出すディープラーニングです。ノーベル物理学賞を受賞したジェフリー・ヒ ントンが開発したディープラーニングを飛躍的に発展させ、実用化した立役者がGoogleです。下記の例は、『Googleの猫』 としてよく知られています。 従来は、AIに猫のラベル(答え)をつけた大量の画像と、「目」 「口」「大きさ」などの目の付けどころ(特徴量)を与えていました。 AIは与えられたものから猫のそれぞれの特徴を学習し、モデル(法 則)を作り、見分けることができるようになります。 ディープラーニングは、AIにデータのみを与え、特徴量はAI自身が 導き出します。得られた結果を新たな特徴量としてさらにモデル(法 則)を作り出します。データにラベルが必要ないため、データにラベル 付けする手間がありません。 出典 https://ics.media/entry/17792/ データサイエンス チュートリアル 14

ルールベースAI、機械学習、ディープラーニング ルールベースAIや一般的な機械学習、ディープラーニングの違いを『特徴量設計』と『ルール生成』の観点からまとめると下記 のようになります。 特徴量設計 ルール生成 特徴量設計 ルール生成 特徴量設計 ルール生成 人間 人間 人間 自動 自動 自動 データサイエンス チュートリアル 15

【参考】 ディープラーニングと従来の機械学習との違い ディープラーニングが威力を発揮するのは非構造化データ(画像、言語、音声など)を扱う際であり、非構造化データの特 徴を抽出するのに有用な手法となります。 構造化データ(表形式)でもディープラーニングは実施可能ですが、従来の機械学習となる勾配ブースティング決定木 (GBDT)などを使用した方が容易にモデルを作成でき、学習時間も短いので、コストは安価になります。 ディープラーニング 一般的な機械学習 特徵 ・非構造化データに高い性能を発揮 ・コストは高い ・構造化データに対して高い性能を発揮 ・ディープラーニングに対して低コスト 得意なデータタイプ 画像、動画、波形、テキスト、 化学分子 テーブル、時系列 特徴量エンジニアリング ほぼ不要 ・線形、 非線形相関などあらゆる特徴量抽出 ・ドメイン知識が求められる ハイパーパラメータチューニング 複雑 簡単 学習時間 長い(数時間~数日以上) 数分~数時間 ハードウェア GPU/TPU CPU/GPU 使用されるライブラリ Keras, Pytorch, Tensorflow LightGBM, XGBoost, CatBoost等 【出典】 ディープラーニングの得意領域 https://www.canon-its.co.jp/column/ai-column/01 データサイエンス チュートリアル 16

【参考】 アノテーション アノテーション アノテーション アノテーション(annotation)は「注釈」「付記」を意味する言葉で、 データサイエンスではデータに意味を付与し、機械学習(ディープラー ニングを含む)に利用できる形に加工・整理する作業を指します。 アノテーションの役割 ●教師データを作成し、AIに正しい出力パターンを学習させる ●膨大なデータを分類・整理し、効率的な学習・管理を可能にする データサイエンス チュートリアル 17

【参考】 アノテーションの実例 実 例 ■ 医療画像 画像の中にある病変部位や体組織に印をつける作業となります。バウンディングボックスと呼ばれる四角形でオブ ジェクトを囲む場合や、セグメンテーションと呼ばれる、オブジェクトの輪郭をなぞるアノテーションが一般的な方法です。 ■ 自然言語処理(NLP) 単語一つ一つに具体的な意味を割り当て、単語間の関係を識別する『セマンティックアノテーション』、人名や地名、 企業名などにカテゴライズする『エンティティアノテーション』、テキスト内に含まれる感情をラベル付けする『センチメン トアノテーション』等がよく用いられます。 ■ 自動運転 車両に搭載されたカメラ、LiDAR(レーザー光を使ったリモートセンシング技術)、レーダーなどが捉えた周囲の データ(画像や3D点群)に対して、「これは歩行者」、「これは標識」といった意味付け(ラベル付け)を行い、 AIが走行環境を正しく認識するための教師データを作るアノテーションが行われています。 データサイエンス チュートリアル 18

【参考】 アノテーションと特徴量の自動化 ディープラーニングの最大の特徴は、データの中から『何が重要な特徴か』を人間が指示しなくても自力で見つけ出す『特徴量 の自動化』にあります。しかし、その抽出した特徴が『結局、何を表しているのか』を学習させるためには、多くの場合でアノテー ションが必要になります。 ディープラーニング以前の手法、すなわち、通常の機械学習では、人間が『エッジ(輪郭)に注目せよ』、『色の彩度を計算せ よ』と数式で特徴を定義していました。ディープラーニングは、この注目すべきポイントを自ら発見することができます。 しかし、AIが『尖った耳』や『ひげ』という特徴を自力で見つけたとしても、それが『猫』という概念に結びつくかどうかは、人間が『こ れは猫だよ』と教えて(アノテーション/正解ラベルの付与)初めて成立するからです。 アノテーションの手間を減らすために注目されている『自己教師あり学習(Self-Supervised Learning)』が、近年のAI (特にChatGPTなどの大規模言語モデル)の飛躍的な進化を支えています。詳細は、下記を参考にしてください。 【参考】 生成AIの進化を支える「自己教師あり学習」:基礎から応用例まで https://zenn.dev/mkj/articles/3f1a948f0d326f データサイエンス チュートリアル 19

データサイエンスのステップ ④ 知恵(1) 父親 母親 祖父 祖母 子 データサイエンス チュートリアル 20