【論文サーベイ】Survey on Diffusion Distillation

1.1K Views

January 13, 25

スライド概要

Web Developer / Research on generative models and continual learning

関連スライド

各ページのテキスト

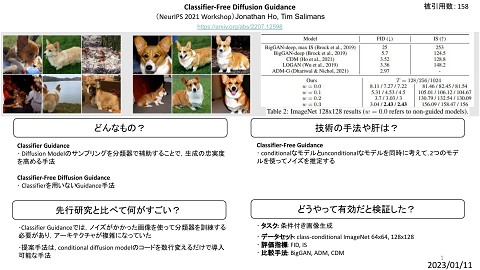

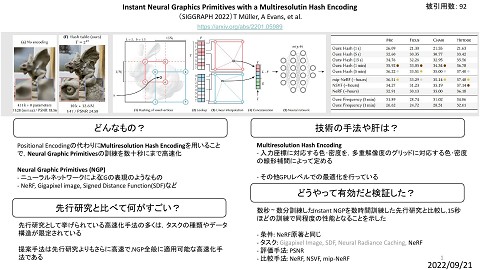

Survey on Diffusion Distillation Progressive Distillation for Fast Sampling of Diffusion Models Tim Salimans, Jonathan Ho [ICLR’22] On Distillation of Guided Diffusion Models Chenlin Meng, Robin Rombach, et. al [CVPR’23] Consistency Models Yang Song, Prafulla Dhariwal, Mark Chen, Ilya Sutskever [ICML’23] Latent Consistency Models: Synthesizing High-Resolution Images with Few-Step Inference Simian Luo, Yiqin Tan, Longbo Huang, Jian Li, Hang Zhao [ICLR’24 reject] Adversarial Diffusion Distillation Axel Sauer, Dominik Lorenz, Andreas Blattmann, Robin Rombach [ECCV’24] 1

- https://dl.acm.org/doi/10.5555/3618408.3619743

- https://openreview.net/pdf/3b30857a628099896b6123e85d6cf04c59abe77b.pdf

- https://dl.acm.org/doi/10.1007/978-3-031-73016-0_6

- https://openreview.net/forum?id=duBCwjb68o

- https://openaccess.thecvf.com/content/CVPR2023/papers/Meng_On_Distillation_of_Guided_Diffusion_Models_CVPR_2023_paper.pdf

Background Diffusion Modelのサンプリングは遅い.DDPMでは1000ステップほどの推論 を要する 高速なサンプリングのために2つのアプローチがある Solver - サンプリングの過程を工夫する Distillation - 知識蒸留によってサンプリングが高速なモデルを獲得する 2

Progressive Distillation for Fast Sampling of Diffusion Models Tim Salimans, Jonathan Ho [ICLR’22] 通常の 2 ステップ分のモデルを1ステップで予測するモデルを繰り返し蒸留する 3

Results ImageNet 64x64 “malamute” についての生成結果 4

On Distillation of Guided Diffusion Models Chenlin Meng, Robin Rombach, et. al [CVPR’23] Guided-Diffusion に対する Pregressive Distillation 5

Consistency Models Yang Song, Prafulla Dhariwal, Mark Chen, Ilya Sutskever [ICML’23] Diffusion Modelとは異なる系統の生成モデルだが, Consistency DistillationによってDiffusion modelから蒸留できる Forward / Reverse Process は時間方向に連続化する ことで,確率フローODEとして表せる その解軌道上で consistency function を学習する 6

Consistency Models consistency function は同じ解軌道上の 任意の について次を満たすものとする シンプルな方法は,初期状態を とする 他にも方法が提案されているが省略する 7

Sampling 時刻 ごとに consistency functionを計算 N-1個のサンプルができるが, その中から最もFIDが小さいものを選ぶ 8

Consistency Distillation と を一致させることを考える は未知なので1ステップデノイズした を使う はODE Solverの1ステップ分の更新 パラメータはEMAで更新する 9

Results 10

Latent Consistency Models: Synthesizing High-Resolution Images with Few-Step Inference Simian Luo, Yiqin Tan, Longbo Huang, Jian Li, Hang Zhao [ICLR’24 reject] Consistency Distillationを Guided Latent Diffusion Model でやったもの 11

Adversarial Diffusion Distillation Axel Sauer, Dominik Lorenz, Andreas Blattmann, Robin Rombach [ECCV’24] Distilled modelの生成画像にはartifact が生じることがある Adversarial lossを導入することで 生成画像がthe manifold of real images に収まるようにする 12

Results 13